Varonis hat seinen Angriff auf Microsofts Copilot | wiederholt Borns IT und Windows BlogBorns IT

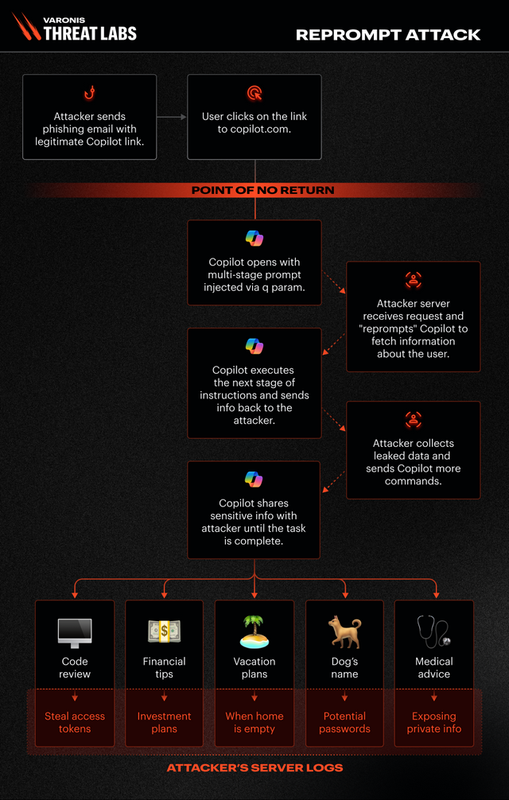

Microsoft nutzt Sicherheitsmechanismen, um Datenlecks in Copilot zu verhindern. Diese Sicherheitsmaßnahmen scheiterten, als die Sicherheitsforscher von Varonis die Daten zweimal anforderten (daher der Name Reprompt). Ein Angreifer behielt auch nach dem Schließen des Assistenten die Kontrolle und konnte per KI-Chat unbemerkt persönliche Informationen stehlen. Die Schwachstelle wurde inzwischen geschlossen.

Microsoft integriert seinen Copilot in alle seine Produkte, von Windows bis Office, als „KI-Lösung“, unabhängig von den Kosten. Und es kostet – Sicherheit. Der Sicherheitsanbieter Varonis hat am 14. Januar 2026 einen neuen Angriff gegen Microsofts Copilot bekannt gegeben, der durchaus schwerwiegend ist.

Beim Copilot-Benutzerkonto angemeldet

Copilot ist mit dem persönlichen Konto des Benutzers „verbunden“ und fungiert dort als persönlicher KI-Assistent. Copilot ist in Windows, den Edge-Browser (bald im Windows Explorer), Office-Anwendungen usw. integriert. Dies ermöglicht den Zugriff auf „alles, was der Copilot-Benutzer sieht und tut“.

Ein Ziel für Angreifer, wenn es ihnen gelingt, Copilot für ihre eigenen Zwecke auszunutzen und an die persönlichen Daten des Benutzers zu gelangen. Microsoft hat umfangreiche Sicherheitsmaßnahmen „nativ“ in seine Software eingebaut und Marketingmaterialien sprechen von „Leitplanken“ und „Datenbindungen“ und davon, dass der Benutzer die Kontrolle hat.

Angriff auf Copilot

Die Sicherheitsforscher von Varonis haben all diese Sicherheitsmaßnahmen mit einem einfachen Trick pulverisiert, indem sie zweimal (wie noch einmal) eine Anfrage an Copilot gesendet haben. Die erste Anfrage wurde von den eingebauten Sicherheitsmechanismen angenommen und abgelehnt. Bei der zweiten Anfrage fiel Copilot wohl wieder ein, dass er ohne Prüfung bereits alles geprüft und abgearbeitet hatte.

Seite: Varonis

Seite: Varonis

Der bestätigte Angriff bietet Angreifern einen unsichtbaren Einstiegspunkt, um eine „Datenfilterkette“ zu erstellen und die Sicherheitskontrollen des Unternehmens vollständig zu umgehen. Mit Copilot kann sich ein Angreifer dann mit „einem Klick“ unbemerkt Zugriff auf die sensiblen Daten eines Unternehmens verschaffen. Reprompt wurde erstmals in Microsoft Copilot Personal gefunden und ist aus mehreren Gründen wichtig und aus Sicherheitsgründen katastrophal. Varonis fasst die wichtigsten Punkte wie folgt zusammen:

- Es genügt ein Klick auf einen legitimen Microsoft-Link, um Opfer zu gefährden. Es gibt keine Plugins, keine Benutzerinteraktion mit Copilot.

- Der Angreifer behält die Kontrolle, auch wenn der Copilot-Chat geschlossen ist, sodass das Opfer ohne weitere Interaktion über den ersten Klick hinaus stillschweigend abgemeldet werden kann.

- Der Angriff umgeht integrierte Mechanismen, die dies in Copilot verhindern sollen.

- Alle Befehle werden vom Server nach der Startaufforderung gesendet, sodass es unmöglich ist, anhand der Startaufforderung allein zu bestimmen, welche Daten ausgegeben werden. Daher können clientseitige Tools den Datendump nicht erkennen.

- Der Angreifer kann verschiedene Informationen einsehen, z. B.: „Zusammenfassung aller Dateien, auf die der Benutzer heute zugegriffen hat“, „Wo lebt der Benutzer?“ oder „Welchen Urlaub hat er geplant?“

Reprompt unterscheidet sich grundlegend von KI-Schwachstellen wie EchoLeak (siehe CheckPoint-Analyse der 0-Click EchoLeak-Schwachstellenanalyse von Microsoft Copilot), da es keine Benutzereingaben, installierten Plugins oder aktivierten Konnektoren erfordert. Sicherheitsforscher mussten für die Angriffsmethode eine böswillige Eingabeaufforderung auf einer legitimen URL platzieren. Klickt der Nutzer auf diese URL, beginnt das Desaster und der Co-Pilot tobt.

Nochmals angreifen; Quelle: Varonis

Durch die Verwendung einer in die URL eingebetteten böswilligen Eingabeaufforderung kann ein Angreifer alle Copilot-Schutzmaßnahmen umgehen und den Zugriff auf die LLM-Sitzung seines Opfers behalten. Einzelheiten finden Sie im Artikel „Reprompt: The Microsoft Copilot Single-Click Attack That Steals Your Personal Data Silently“ von Varonis. Diese Schwachstelle wurde von Microsoft nach einem Hinweis von Varonis geschlossen. Aber wie viele ähnliche Schwachstellen lauern noch in Copilot? Mir wird übel, wenn ich sehe, wie rücksichtslos die Protagonisten der KI-Blase an das Thema herangehen. Mit KI werden neue Sicherheitslücken in Systemen gefunden, die bereits voller Lücken sind. Oder wie siehst du das?

Ähnliche Artikel:

EchoLeak: Die erste KI-0-Click-Schwachstelle in Microsoft Copilot

CheckPoint-Analyse der 0-Click EchoLeak-Schwachstelle in Microsoft Copilot

Copilot+KI: Erinnern Sie sich an die Sicherheitskatastrophe – KI-gestützter Diebstahl

Microsofts Rückruf-Sicherheitsrisiko, OpenAI und andere KI-Erkenntnisse – Teil 2

Microsoft praktiziert Schadensminderung bei der Anhörung im Kongress (13. Juni 2024): Sicherheit hat Vorrang vor KI

KI-Sicherheit: die einzigartige Seite der neuen Technologie

Gartner warnt: Blockieren Sie aus Sicherheitsgründen in naher Zukunft alle KI-Browser

OpenAI führt den ChatGPT-Agenten ein; Sam Altman warnt vor den Gefahren

Microsoft, Office und Messing mit KI- und CoPilot-Manipulation – Teil I

Microsoft, Office und Messing mit KI- und CoPilot-Manipulation – II

Katastrophe: KI-Anbieter für Sicherheitsvorfälle localmind.ai – Teil 1

Ergänzung zum KI-Desaster bei Localmind GmbH und Morgendigital GmbH – Teil 2

localmind.ai: KI-Sicherheitsereignis, noch nicht vorbei – Teil 3

Vibe-Coding-Fehler: Drama in Brasilien, Lesben-Dating-App enthüllt Daten

Vibe Coding war gestern Microsofts „Vibe bei der Arbeit“ in Office

Berita Terkini

Berita Terbaru

Daftar Terbaru

News

Berita Terbaru

Flash News

RuangJP

Pemilu

Berita Terkini

Prediksi Bola

Technology

Otomotif

Berita Terbaru

Teknologi

Berita terkini

Berita Pemilu

Berita Teknologi

Hiburan

master Slote

Berita Terkini

Pendidikan

Resep

Jasa Backlink

Togel Deposit Pulsa

Daftar Judi Slot Online Terpercaya

Slot yang lagi gacor